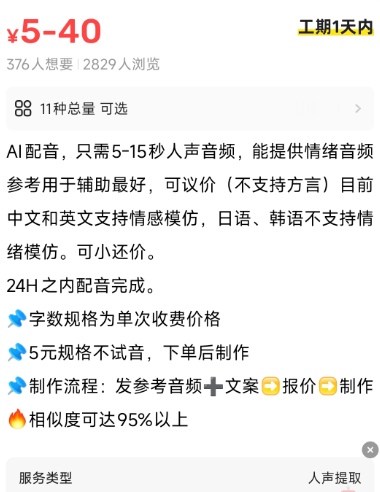

“我做不到”——这句话你可能听过很多次,但你可能不知道人工智能在大力营销这种声音。从《甄凡传奇》中的甄凡,到《无间道》中的刘建明,人工智能正在集体“挪用”这些熟悉的声音,将它们配音成短剧、有声读物、广告。鉴于这种情况,3月底,不少知名配音演员公开表达了自己的看法。例如,为《甄嬛传》、《疯狂动物城》等代表作配音的演员季冠霖发文称:“未经本人许可,采集本人声音进行人工智能合成,生成与本人声音极为相似的AI语音,对视频内容进行商业及非商业目的二次加工创作,此类作品的传播和使用严重侵犯本人合法权益。”边江、张杰等配音演员转发并共同表达。时间这是中国配音界针对人工智能语音侵权最大规模的集体反击。新京报贝壳财经记者发现,以前需要专业录音室和大量样本的声音克隆,现在只需使用开源模型和少量音频素材就可以实现。在一些电商平台上,完全“复制”一段语音的成本低至5元,购买音频复制软件的成本甚至低至1元。如何“窃取”配音演员的声音?为何维权之路如此艰难?这种话语权游戏挑战了技术时代的道德结果。浙江垦丁律师事务所首席律师张燕来在接受新京报贝壳财经记者采访时表示,保护配音演员权益的措施是AI时代保护数字人格权利的必然,也是法律的合理要求。人工智能技术发展的限制。 “蒙眼跑”AI语音克隆技术:软件1元,服务5元 季冠霖负责配音《甄凡传奇》、《疯狂动物城》等著名影视作品。她说:“被魔法改变了。”印度版的《甄嬛传》中,甄嬛的声音是她的,但角色却根本不是她的。我发现他们的声音很相似,但性格却不同。这种“声音相似但没有灵魂”的刺耳声音是AI语音模仿的致命问题,也是配音演员愤怒的原因。他们的声音被用作免费素材,并批量发送给人工智能,然后被使用。新京报贝壳财经记者发现,AI模仿的技术门槛已达到个位数,甚至可以使用免费开源软件完成,但同时侵权者可以利用短视频平台、影视剧片段、配音作品获取大量利益。大量未经授权的音频材料。某电商平台截图 记者用相关关键词搜索某电商平台,发现该平台提供原创语音、文案相关服务,最终费用在5元至100元不等。 ,有的公司直接销售语音克隆软件,价格低至1元。卖家在介绍中称,该软件“适用于自有媒体、短视频叙事、有声读物等,以及克隆名人的‘创意游戏’”。事实上,记者在开源平台上发现了类似的语音克隆软件,用户可以免费下载。完成语音克隆需要多长时间?贝壳财经记者发现,在供应商促销活动中,3-15秒的音频文件足以完成语音的“一对一播放”。从这个意义上来说,记者第一次体验了开源版的人工智能软件。经过三分钟的“训练”该软件利用记者自己的录音,重新创建了记者的“声音模型”。然后输入您的文本,软件将口头播放您自己的声音。记者发现,训练模型后,模型对自己的一些发音习惯记忆犹新。对于短句,记者本人也是由机器合成的。有些我无法辨别是声音。生成长句子时会发生崩溃。然而,每当我们多次生成句子并选择合成效果较大的句子时,总会有声音可以“真实”。值得注意的是,这种人工智能软件的创建者并非没有意识到他们的软件可以用来模仿其他人的声音。例如,某个软件的作者将用户界面标记为“该软件是在 MIT 许可证下开源的。作者对该软件没有控制权。该软件的用户以及传播该软件导出的声音的人有厂商告诉记者,该软件“仅供个人研究使用”。AI仿声比AI换脸隐秘性大得多,保护成本也更高。另一方面,相比有时引起关注的“AI搞笑脸”,AI仿声的侵权维权难度更大。这是因为AI可以通过对多个配音演员的音色、语调进行微调,“匹配”声纹,形成高度相似的仿声,从而实现仿声的效果。 “相似度高但1:1再现。”配音演员李龙斌说:“我的朋友经常给我发消息问我‘先生’。”龙斌,这是你的声音吗?’”当我问他们的时候,他们非常相似。特别是因为很短,经过手动调整,相似度超过了90%。比如《激战》中我扮演张家辉的场景,经常是通过换词来重现的。有时我必须自己去区分。e的链条人工智能语音再现的证据收集甚至更弱。网络上流传的人工智能声音大多都是碎片化、二次加工的,很难追根溯源,难以对整个违规环节进行补救。配音演员叶青弱弱地说,一般情况下,应该找点击率比较高、有维权价值的视频。查找有关视频编辑器的信息可能很困难。律师们花了很长时间,也许一年,才找到初犯。然后就是收集证据的问题。我会这么做的。如何证明声音是你的?接下来,您可能需要进行声纹识别,这实际上需要时间和精力。目前司法实践中,对于如何判定人工智能模仿侵权行为尚无统一标准。日本首例侵犯人工智能语音精神权案件揭示语音权益保护范围自然人的声音可以扩展到人工智能声音,只要它们是可识别的。然而,确定“可识别性”的标准模型并不明确:有的认为“当事人”可以识别,有的则要求“公众”可以识别。如果你不是明星配音演员,即使你的声音很相似,也不能被视为侵权。音频可编辑、欺骗、变速,AI微调实现“相似度高、不可复制”。法医鉴定尚无统一标准。然而,一些侵权者却利用维权成本高、取证难、身份难辨认等特点,故意试图利用配音演员的声音来牟取不择手段的利益。由于人工智能模仿的隐蔽性,保护之路充满荆棘。配音演员面临着许多挑战。取证链条薄弱,违规环节严重难以追踪。难以识别和难以定义技能水平。维权成本高,绩效成本低。立法进展缓慢,监管存在漏洞。四个核心困境迫使许多人放弃突破。这也是AI山寨违规行为快速增加的主要原因。用魔法打败魔法?专家建议使用水印等技术措施来“打击假冒”。 “从法律角度来看,使用特定的人声来训练人工智能模型并未经许可使用,很可能侵犯配音演员的道德话语权,甚至可能导致不正当竞争。这与使用他人的形象或名称进行商业宣传的逻辑类似。”张燕来告诉贝壳财经记者。 《中华人民共和国民法典》第一千零二十三条明确,自然人的言论权受公开权保护,该言论具有公开权。作为人格标识符的依赖法律地位。 20242019年4月,北京互联网法院对全国首例涉及人工智能生成音频的精神权利侵犯案件作出一审判决。法律明确规定,人类自然语音权益的保护范围可以延伸至人工智能生成的语音,只要它是可识别的。被告赔偿原告各项损失25万元。这一事件让业界有了安全感。但这还不够。 “从商业角度来看,如果使用配音演员的声音进行免费、无限制的AI训练,配音演员将无法控制其声音的商业用途,这将直接损害其利益。” “目前司法实践中存在支持人工智能领域话语权保护的诉讼,未来此类维权诉讼及相关诉讼将会越来越多张燕来对贝壳财经记者表示。由于克隆人工智能声音的权益很难得到保障,有专家呼吁未来建立一个安全框架,通过水印等技术手段,让人工智能声音可追溯、可识别。在技术层面,张燕来表示,可以通过技术手段嵌入数字水印和元数据,让人工智能生成的音视频内容可溯源,准确识别内容来源。这类技术可以快速帮助平台和监管机构。检测错误信息并阻止其传播。可以开发更强大的人工智能模型来检测深度伪造内容,这种类型的防伪人工智能可以应用于社交媒体和新闻平台等,以自动过滤虚假内容。一些专家认为,将水印融入人工智能声音需要统一和标准化的技术标准。单独整数以增加未来的问责制。有关联语句、多级监督体系、指示体系、取证体系。随着水平的逐步提高,可以快速建立演员配音的有效保护机制。其实,技术本身并无好坏之分,只是其使用是有限制的。这条分界线就是个人权利的尊严。 AI可以再现音调,但很难再现配音演员本人的情感流动和即兴创作灵感。人声的“人体温度”无法通过算法量化。北京贝壳财经报记者 罗一丹 编辑 岳彩洲 编辑 付春明

“我做不到”——这句话你可能听过很多次,但你可能不知道人工智能在大力营销这种声音。从《甄凡传奇》中的甄凡,到《无间道》中的刘建明,人工智能正在集体“挪用”这些熟悉的声音,将它们配音成短剧、有声读物、广告。鉴于这种情况,3月底,不少知名配音演员公开表达了自己的看法。例如,为《甄嬛传》、《疯狂动物城》等代表作配音的演员季冠霖发文称:“未经本人许可,采集本人声音进行人工智能合成,生成与本人声音极为相似的AI语音,对视频内容进行商业及非商业目的二次加工创作,此类作品的传播和使用严重侵犯本人合法权益。”边江、张杰等配音演员转发并共同表达。时间这是中国配音界针对人工智能语音侵权最大规模的集体反击。新京报贝壳财经记者发现,以前需要专业录音室和大量样本的声音克隆,现在只需使用开源模型和少量音频素材就可以实现。在一些电商平台上,完全“复制”一段语音的成本低至5元,购买音频复制软件的成本甚至低至1元。如何“窃取”配音演员的声音?为何维权之路如此艰难?这种话语权游戏挑战了技术时代的道德结果。浙江垦丁律师事务所首席律师张燕来在接受新京报贝壳财经记者采访时表示,保护配音演员权益的措施是AI时代保护数字人格权利的必然,也是法律的合理要求。人工智能技术发展的限制。 “蒙眼跑”AI语音克隆技术:软件1元,服务5元 季冠霖负责配音《甄凡传奇》、《疯狂动物城》等著名影视作品。她说:“被魔法改变了。”印度版的《甄嬛传》中,甄嬛的声音是她的,但角色却根本不是她的。我发现他们的声音很相似,但性格却不同。这种“声音相似但没有灵魂”的刺耳声音是AI语音模仿的致命问题,也是配音演员愤怒的原因。他们的声音被用作免费素材,并批量发送给人工智能,然后被使用。新京报贝壳财经记者发现,AI模仿的技术门槛已达到个位数,甚至可以使用免费开源软件完成,但同时侵权者可以利用短视频平台、影视剧片段、配音作品获取大量利益。大量未经授权的音频材料。某电商平台截图 记者用相关关键词搜索某电商平台,发现该平台提供原创语音、文案相关服务,最终费用在5元至100元不等。 ,有的公司直接销售语音克隆软件,价格低至1元。卖家在介绍中称,该软件“适用于自有媒体、短视频叙事、有声读物等,以及克隆名人的‘创意游戏’”。事实上,记者在开源平台上发现了类似的语音克隆软件,用户可以免费下载。完成语音克隆需要多长时间?贝壳财经记者发现,在供应商促销活动中,3-15秒的音频文件足以完成语音的“一对一播放”。从这个意义上来说,记者第一次体验了开源版的人工智能软件。经过三分钟的“训练”该软件利用记者自己的录音,重新创建了记者的“声音模型”。然后输入您的文本,软件将口头播放您自己的声音。记者发现,训练模型后,模型对自己的一些发音习惯记忆犹新。对于短句,记者本人也是由机器合成的。有些我无法辨别是声音。生成长句子时会发生崩溃。然而,每当我们多次生成句子并选择合成效果较大的句子时,总会有声音可以“真实”。值得注意的是,这种人工智能软件的创建者并非没有意识到他们的软件可以用来模仿其他人的声音。例如,某个软件的作者将用户界面标记为“该软件是在 MIT 许可证下开源的。作者对该软件没有控制权。该软件的用户以及传播该软件导出的声音的人有厂商告诉记者,该软件“仅供个人研究使用”。AI仿声比AI换脸隐秘性大得多,保护成本也更高。另一方面,相比有时引起关注的“AI搞笑脸”,AI仿声的侵权维权难度更大。这是因为AI可以通过对多个配音演员的音色、语调进行微调,“匹配”声纹,形成高度相似的仿声,从而实现仿声的效果。 “相似度高但1:1再现。”配音演员李龙斌说:“我的朋友经常给我发消息问我‘先生’。”龙斌,这是你的声音吗?’”当我问他们的时候,他们非常相似。特别是因为很短,经过手动调整,相似度超过了90%。比如《激战》中我扮演张家辉的场景,经常是通过换词来重现的。有时我必须自己去区分。e的链条人工智能语音再现的证据收集甚至更弱。网络上流传的人工智能声音大多都是碎片化、二次加工的,很难追根溯源,难以对整个违规环节进行补救。配音演员叶青弱弱地说,一般情况下,应该找点击率比较高、有维权价值的视频。查找有关视频编辑器的信息可能很困难。律师们花了很长时间,也许一年,才找到初犯。然后就是收集证据的问题。我会这么做的。如何证明声音是你的?接下来,您可能需要进行声纹识别,这实际上需要时间和精力。目前司法实践中,对于如何判定人工智能模仿侵权行为尚无统一标准。日本首例侵犯人工智能语音精神权案件揭示语音权益保护范围自然人的声音可以扩展到人工智能声音,只要它们是可识别的。然而,确定“可识别性”的标准模型并不明确:有的认为“当事人”可以识别,有的则要求“公众”可以识别。如果你不是明星配音演员,即使你的声音很相似,也不能被视为侵权。音频可编辑、欺骗、变速,AI微调实现“相似度高、不可复制”。法医鉴定尚无统一标准。然而,一些侵权者却利用维权成本高、取证难、身份难辨认等特点,故意试图利用配音演员的声音来牟取不择手段的利益。由于人工智能模仿的隐蔽性,保护之路充满荆棘。配音演员面临着许多挑战。取证链条薄弱,违规环节严重难以追踪。难以识别和难以定义技能水平。维权成本高,绩效成本低。立法进展缓慢,监管存在漏洞。四个核心困境迫使许多人放弃突破。这也是AI山寨违规行为快速增加的主要原因。用魔法打败魔法?专家建议使用水印等技术措施来“打击假冒”。 “从法律角度来看,使用特定的人声来训练人工智能模型并未经许可使用,很可能侵犯配音演员的道德话语权,甚至可能导致不正当竞争。这与使用他人的形象或名称进行商业宣传的逻辑类似。”张燕来告诉贝壳财经记者。 《中华人民共和国民法典》第一千零二十三条明确,自然人的言论权受公开权保护,该言论具有公开权。作为人格标识符的依赖法律地位。 20242019年4月,北京互联网法院对全国首例涉及人工智能生成音频的精神权利侵犯案件作出一审判决。法律明确规定,人类自然语音权益的保护范围可以延伸至人工智能生成的语音,只要它是可识别的。被告赔偿原告各项损失25万元。这一事件让业界有了安全感。但这还不够。 “从商业角度来看,如果使用配音演员的声音进行免费、无限制的AI训练,配音演员将无法控制其声音的商业用途,这将直接损害其利益。” “目前司法实践中存在支持人工智能领域话语权保护的诉讼,未来此类维权诉讼及相关诉讼将会越来越多张燕来对贝壳财经记者表示。由于克隆人工智能声音的权益很难得到保障,有专家呼吁未来建立一个安全框架,通过水印等技术手段,让人工智能声音可追溯、可识别。在技术层面,张燕来表示,可以通过技术手段嵌入数字水印和元数据,让人工智能生成的音视频内容可溯源,准确识别内容来源。这类技术可以快速帮助平台和监管机构。检测错误信息并阻止其传播。可以开发更强大的人工智能模型来检测深度伪造内容,这种类型的防伪人工智能可以应用于社交媒体和新闻平台等,以自动过滤虚假内容。一些专家认为,将水印融入人工智能声音需要统一和标准化的技术标准。单独整数以增加未来的问责制。有关联语句、多级监督体系、指示体系、取证体系。随着水平的逐步提高,可以快速建立演员配音的有效保护机制。其实,技术本身并无好坏之分,只是其使用是有限制的。这条分界线就是个人权利的尊严。 AI可以再现音调,但很难再现配音演员本人的情感流动和即兴创作灵感。人声的“人体温度”无法通过算法量化。北京贝壳财经报记者 罗一丹 编辑 岳彩洲 编辑 付春明